接触爬虫的第一天

第一步:现将python环境搭建好,工欲利其事必先利其器!

第二步:寻找目标网站,我选择的网站是http://www.win4000.com,里面有一个美女板块,里面有各种小姐姐的照片(你懂的)

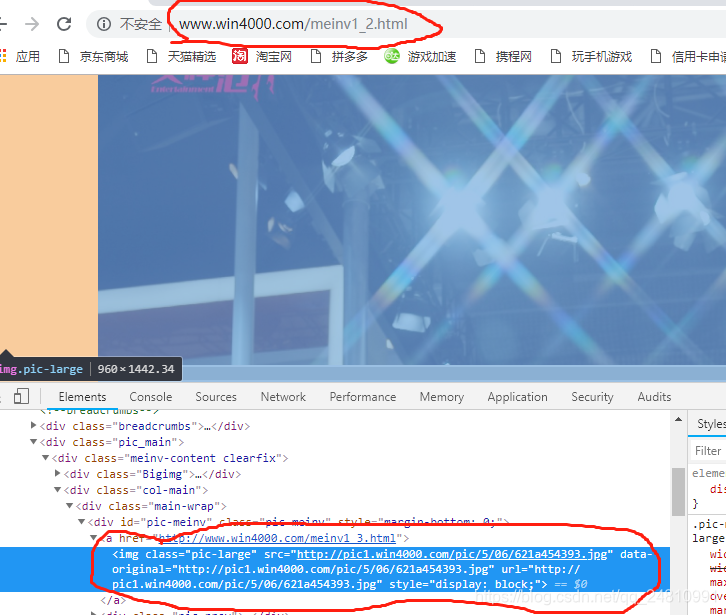

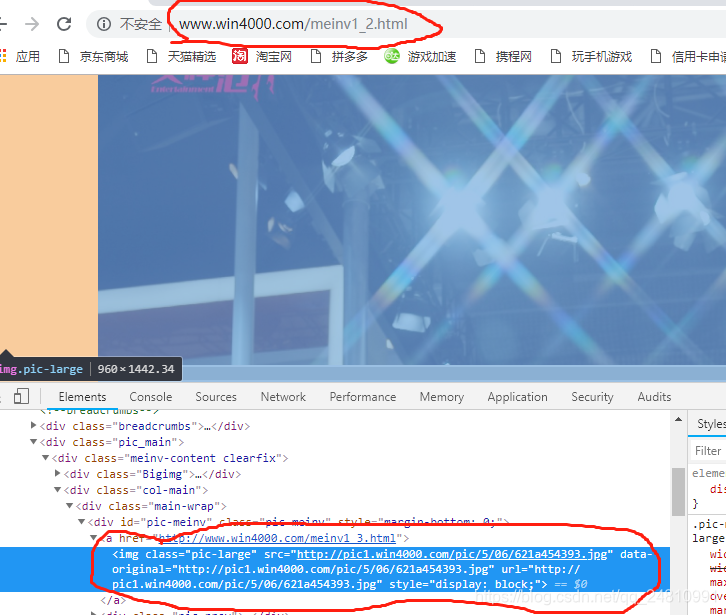

第三步:分析目标网站的html源码及网页规则

通过分析我发现,该网页每个人物的每个图片都是

http://www.win4000.com/meinv1_2.html

http://www.win4000.com/meinv1_3.html

http://www.win4000.com/meinv2_1.html

http://www.win4000.com/meinv2_2.html

并且所有图片地址都存放在一个 中

中

from bs4 import BeautifulSoup

import requests

import os

os.system ("title Py爬取小姐姐,李天行版权所有")

print ("爬取的图片都在D:/img文件夹下")

root = 'D://img//'

for page in range(1,1000):

for p in range(1,20):

url = 'http://www.win4000.com/meinv'+str(page)+'_'+str(p)+'.html'

r = requests.get(url)

r.encoding='utf-8'

if r.status_code!=404:

demo = r.text

soup = BeautifulSoup(demo, "html.parser")

text = soup.find_all('img',class_ = 'pic-large')

for img in text:

imagr_url = img.get('data-original')

file_name = root + imagr_url.split('/')[-1]

try:

if not os.path.exists(root):

os.mkdir(root)

if not os.path.exists(file_name):

s = requests.get(imagr_url)

with open(file_name, "wb") as f:

f.write(s.content)

print("爬取完成")

else:

print("文件已存在")

except Exception as e:

print("爬取失败:" + str(e))

|

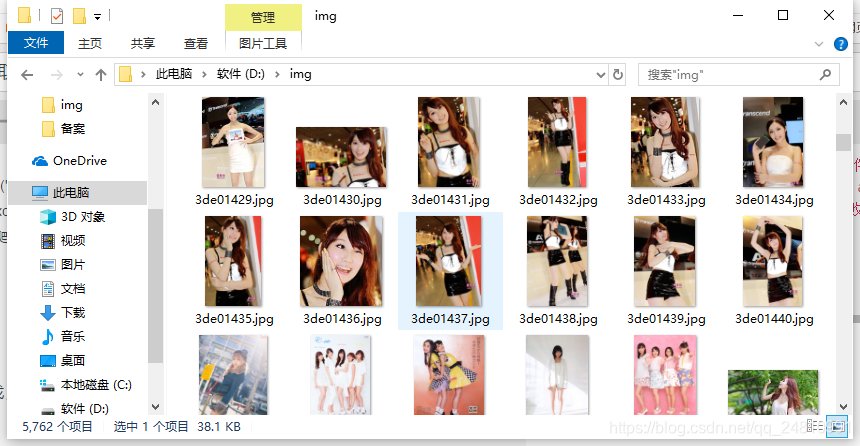

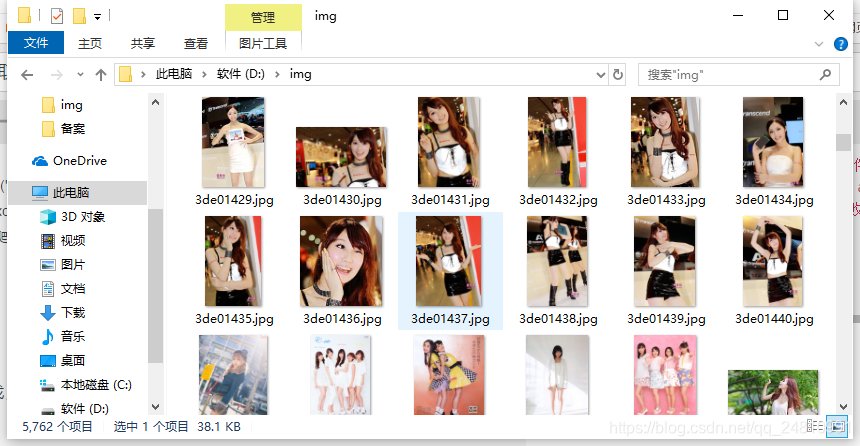

哈哈哈哈大功告成,以下是成果展示

总结:

1、该方式爬取为单进程爬取,只能一张一张爬取

2、进行图片请求时一定要注意不要使用之前使用过的变量

3、细心、认真、不浮躁

中